10 Gründe für Software-defined Storage

Software-defined Storage (SDS) ist in der Speicherbranche derzeit in aller Munde. Neben dem öffentlichen Marketing-Hype gibt es handfeste wirtschaftliche wie technologische Argumente. Wir fassen die zehn wichtigsten Gründe zusammen, warum Software-definierte Speicherinfrastrukturen für fast jedes Unternehmen Sinn machen.

Software-defined Storage (SDS) ist in der Speicherbranche derzeit in aller Munde. Neben dem öffentlichen Marketing-Hype gibt es handfeste wirtschaftliche wie technologische Argumente. Wir fassen die zehn wichtigsten Gründe zusammen, warum Software-definierte Speicherinfrastrukturen für fast jedes Unternehmen Sinn machen.Robert Thurnhofer, Marketing Manager Central Europe

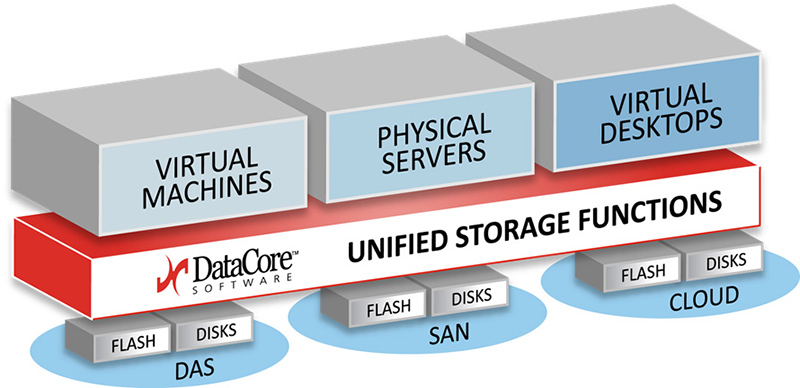

Grafik: Datacore SoftwareKomplett neu ist dabei der »Software-defined Storage«-Ansatz (SDS) eigentlich nicht. DataCores Mission-Statement von 1998 lautete »Software-driven Storage Architecture«, und seither hat man die »SANsymphony-V«-Software konsequent in diese Richtung weiterentwickelt. Heute vertrauen über 15.000 Kunden auf die SDS-Plattform von Datacore. Mittlerweile sind nicht nur die Analysten von IDC, Forrester und Gartner überzeugt, dass Storage in Zukunft über die Software definiert wird. Auch die in der Regel Hardware-orientierten großen Storage-Hersteller haben den Trend erkannt und beginnen ihre Lösungen entsprechend zu positionieren.

Grafik: Datacore SoftwareKomplett neu ist dabei der »Software-defined Storage«-Ansatz (SDS) eigentlich nicht. DataCores Mission-Statement von 1998 lautete »Software-driven Storage Architecture«, und seither hat man die »SANsymphony-V«-Software konsequent in diese Richtung weiterentwickelt. Heute vertrauen über 15.000 Kunden auf die SDS-Plattform von Datacore. Mittlerweile sind nicht nur die Analysten von IDC, Forrester und Gartner überzeugt, dass Storage in Zukunft über die Software definiert wird. Auch die in der Regel Hardware-orientierten großen Storage-Hersteller haben den Trend erkannt und beginnen ihre Lösungen entsprechend zu positionieren.

Erstaunlich ist diese Einsicht, weil sie es waren, die Storage-Infrastrukturen lange Zeit als proprietäre Inseln behandelten, was ihnen hohe Margen und unfreiwillige Kundenbindungen bescherte. SDS ist deswegen mehr als ein Hype, es ist ein Paradigmenwechsel: Hardware wird zur Standardware, unabhängig von Entwicklungen auf der Ebene von (Giga-)Bits und (Peta-)Bytes.

Der Trend zu Software-defined Storage ist dabei nicht zwangsläufig mit dem exponentiellen Datenwachstum zu begründen. Vielmehr ist es die wirtschaftliche Vernunft gegen das lange verbreitete »Ex und Hopp« (Rip & Replace). Durch die Flexibilität virtualisierter Rechenzentren drängt SDS jetzt mit Macht voran. Jedoch kommt die Technologie nicht aus dem Nichts, sie ist längst ausgereift und wirtschaftlich sinnvoll. Wir nennen zehn gute Gründe, warum ein Einstieg in SDS lohnt:

1. Niedrige Anfangsinvestition

SDS mit Lösungen wie Sansymphony-V haben sich zunächst im Mittelstand und in sehr Budget-begrenzten Umfeldern wie etwa Krankenhäusern etabliert. Diese »Early Adaptors« der zu Grunde liegenden Storage-Virtualisierung begründeten ihre Entscheidung einfach damit, dass sie akute Anforderungen gar nicht anders finanzieren konnten. Erst die Kombination aus Midrange-Hardware und der intelligenten Software-Schicht konnte die Probleme lösen. Die Software setzt auf Standardservern auf, und nutzt deren Ressourcen für eine Optimierung der angeschlossenen, günstigeren Hardware, um Enterprise-Leistungsmerkmale zu realisieren.

2. Senkung der Hardware-Kosten

Üblicherweise wird ein Storage-System alle drei bis fünf Jahre gegen eine neue Hardware-Generation ausgetauscht, schon allein, um erhöhte Wartungskosten für Altgeräte zu vermeiden. Aufwändige Datenmigrationen und eine Neuschulung der Mitarbeiter auf die neuen Systeme waren mit dem Hardware-Austausch verbunden. Um für Unwägbarkeiten gewappnet zu sein, wurden die Lösungen überproportioniert.

Eine SDS-Architektur beseitigt diesen unwirtschaftlichen Speicherbetrieb, da Hardware unabhängig vom Anbieter bei Bedarf marktgerecht und nach optimalem Preis-/Leistungsverhältnis erweitert werden kann. Die Software-Schicht ermöglicht dabei Migrationen im laufenden Geschäftsbetrieb ohne Ausfallzeiten. Die vorhandene Hardware kann mit eingebunden und für weniger priorisierte Aufgaben wie Archivierung oder Tests weiter und optimal genutzt werden.

3. Zukunftssichere Plattform

Der Lebenszyklus einer Software ist im Vergleich zur Hardware länger, die Produktaktualisierung erfolgt jedoch beträchtlich schneller. So kann eine SDS-Plattform innerhalb weniger Wochen neue Technologien (Protokolle, Schnittstellen, Disk-Größen, Prozessor- und Controller-Generationen) integrieren, während bei Hardware-Lösungen aus technischen wie vertriebstaktischen Gründen deutlich längere Integrationszyklen der Fall sind. Die Flexibilität, State-of-the-Art zu bleiben, ist durch einen unabhängigen Software-Ansatz langfristig gewährleistet. Die Software versorgt hierbei nicht nur die heterogenen Speicher-Ressourcen mit immer neuen Leistungsmerkmalen, sondern sie selbst ist auch transportabel und kann auf neuen Server-Generationen zu höherer Leistung ausgebaut werden.

4. Effizienz des Speichermanagements

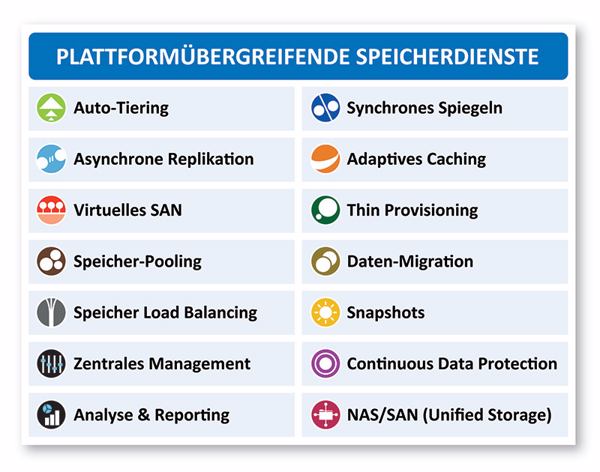

Grafik: Datacore SoftwareSDS ist eine zentrale Plattform für das Management von Speicherkapazität, Performance und Datensicherheit. Synchrone Spiegelung, Thin-Provisioning, Snapshots, asynchrone Replikation, High-Speed-Caching, Auto-Tiering, CDP usw. benötigen keine herstellerspezifischen Tools oder Zusatzlizenzen, sie stehen für sämtliche Hardware geräteübergreifend zu Verfügung.

Grafik: Datacore SoftwareSDS ist eine zentrale Plattform für das Management von Speicherkapazität, Performance und Datensicherheit. Synchrone Spiegelung, Thin-Provisioning, Snapshots, asynchrone Replikation, High-Speed-Caching, Auto-Tiering, CDP usw. benötigen keine herstellerspezifischen Tools oder Zusatzlizenzen, sie stehen für sämtliche Hardware geräteübergreifend zu Verfügung.

Die Software-Schicht ermöglicht neben dem zentralen Management heterogener Speicherressourcen auch die weitgehende Automatisierung von Prozessen. Insbesondere in Umgebungen mit hunderten virtuellen Servern ist dies ein erheblicher Zeit- und Kostenfaktor. So fungiert SDS als ein universaler Storage-Controller für Disk, Flash, SSD und Cloud-Speicher. Analyse, Auswertung und Diagnose über die Speichernutzung sind erst über die zentrale Plattform sinnvoll.

Diese Zentralisierung erlaubt darüber hinaus die Einbettung in die Management-Tools der Hypervisoren wie VMware oder Hyper-V. In der Praxis reichen die Kenntnisse zur Administration eines herkömmlichen Windows-Servers heute aus, um ein SAN auf Basis von SDS zu verwalten.

5. Permanente Hochverfügbarkeit

Hochverfügbarkeit (High Availability) mit transparentem Failover konnte lange nur durch Highend-Speichersysteme mit zusätzlichen Software-Lizenzen bewerkstelligt werden, sprich mit einer Investition im deutlich sechsstelligen Euro-Bereich. Erst durch unabhängige Speichervirtualisierung auf reiner Software-Ebene und mit Hardware von der Stange kann man diese Kosten drastisch senken, und eine redundante Infrastruktur ab etwa 30.000 Euro aufbauen. Neben dem kaufmännischen Aspekt ermöglicht SDS technisch die Integration großvolumiger SATA-Platten, schnellerer SAS-Spindeln genauso wie die Einbindung von Flash/SSD in Hochverfügbarkeitskonzepte.

6. Effizientes Disaster Recovery

Tatsächlich vermarkten einige Storage-Hersteller Hochverfügbarkeitslösungen mit Ausfallzeiten von (nur) wenigen Stunden, andere propagieren High Availability-Konzepte (HA) innerhalb einer Storage-Box. In einer SDS-Architektur bedeutet HA jedoch keinerlei Ausfallzeit auf der Basis räumlich getrennter Ressourcen. Neben dieser echten Hochverfügbarkeit bietet eine SDS-Plattform umfassende Möglichkeiten für Notfallszenarien (Disaster Recovery). In einem ausgereiften Software-Stack wie dem von Sansymphony-V sind dafür Snapshots, Continuous-Data-Protection und asynchrone Replikationen integriert.

Dort können entfernte Rechenzentren von Außenstellen oder Abteilungen Daten in der Zentrale sichern (Many to One) oder im Katastrophenfall für die Wiederherstellung der Zentrale genutzt werden (One-to-Many). Kostenintensive, passive Ausweichrechenzentren werden durch dieses multidirektionale Disaster-Recovery obsolet.

7. Performance-Steigerung durch Caching

Wenn im Umfeld virtueller Maschinen über Performance gesprochen wird, erwartet man zunächst Flash oder SSD. Im Vergleich zu diesen ist DRAM jedoch um ein Vielfaches schneller, insbesondere bei Schreibprozessen. Mit einer Hardware-unabhängigen SDS-Lösung wie SANsymphony-V kann diese Server-Ressource für intelligente Caching-Algorithmen genutzt werden, um Lese- und Schreibzugriffe auf den darunter liegenden Storage zu beschleunigen. Da die Speichervirtualisierung auf Datenblockebene erfolgt, können diese zudem zu einer optimalen Schreibgröße gebündelt werden, was bei SSD zu einer höheren Haltbarkeit führt.

8. Auto-Tiering mit Flash und SSD

SDS beherrscht in der Regel automatisches Tiering zwischen heterogenen Speicher-Ressourcen. Mit dem Auto-Tiering migriert die Storage-Software Datenblöcke von langsamerer auf schnellere Hardware wie SSD automatisch. So können Performance-Steigerungen von bis zu 500 Prozent bei geschäftskritischen Applikationen wie Datenbanken erzielt werden. Durch die Verteilung der I/O-intensiven Workloads auf Datenblockebene können die teuren Ressourcen jedoch sehr effizient eingesetzt werden. Im Gegensatz zu Hardware-Lösungen, die oft auf nur zwei Speicherklassen ausgelegt sind, kommt eine SDS-Lösung wie Sansymphony-V bereits auf 15 Tiers. Damit kann die Optimierung noch granularer erfolgen und auch Qualitätsunterschiede bei verschiedenen SSD-Klassen abbilden. Dadurch, dass das Tiering geräteunabhängig erfolgt, können SSD-Komplettsysteme ebenso eingesetzt werden wie einfache SSD-(PCIE-)Karten, die einfach in den Server eingebaut werden.

9. Wachstumspfade für Virtual-SANs

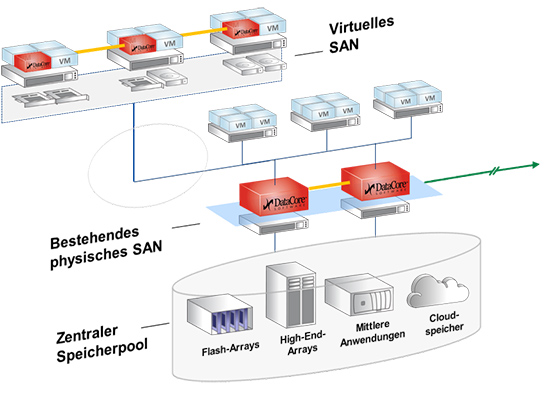

Grafik: Datacore SoftwareSDS beschreibt zunächst die Virtualisierung physischer SANs. Eine relative neue Entwicklung sind Virtual SANs, die Speicherressourcen auf der Applikationsseite, also Direct-Attached-Storage, als geteilten Speicher für virtuelle Maschinen zur Verfügung stellen. Herkömmliche VSAN-Lösungen benötigen dabei allerdings SSD und skalieren dennoch nicht über KMU- oder Abteilungsebene hinaus.

Grafik: Datacore SoftwareSDS beschreibt zunächst die Virtualisierung physischer SANs. Eine relative neue Entwicklung sind Virtual SANs, die Speicherressourcen auf der Applikationsseite, also Direct-Attached-Storage, als geteilten Speicher für virtuelle Maschinen zur Verfügung stellen. Herkömmliche VSAN-Lösungen benötigen dabei allerdings SSD und skalieren dennoch nicht über KMU- oder Abteilungsebene hinaus.

Anders verhält es sich mit der DataCore-Plattform. Zunächst kann das Datacore »Virtual SAN« auf bis zu 32 Server gestreckt und mit ausreichend Performance auch ohne SSD unterstützt werden. Die Nutzung des DRAM in den Knoten als Lese-/Schreib-Cache bei der Datacore-Lösung bedeutet einen erheblichen Leistungsvorteil gegenüber virtuellen SANs, von denen als Lese-Cache nur langsamerer Flash-Speicher verwendet wird.

Bei noch höheren Anforderungen kann das virtuelle SAN aber auch nahtlos in das SAN-Umfeld mit Sansymphony-V integriert werden. Performance und Kapazität können dadurch nahezu ohne Beschränkung wachsen. Virtuelle SANs von Datacore eignen sich als Shared-Storage für VMware- und »Hyper-V«-Umgebungen, zur Leistungssteigerung geschäftskritischer Anwendungen, erzeugen eine höhere Dichte virtueller Desktops pro Server und reduzieren die Kosten und Komplexität gegenüber dezentralem Speicher.

10. Universalplattform für eine dynamische Geschäftsentwicklung

Software-defined Storage stellt die Umsetzung eines flexiblen Unified Storage-Konzeptes dar, das sich für kleine und mittelständische ebenso wie für große Unternehmen eignet. Durch die logische Trennung von Software-Funktionalität und Speicher-Hardware erhalten Firmen die Freiheit und Flexibilität, Speicherarchitekturen langfristig beizubehalten und Business-Continuity für dynamische Geschäftsprozesse zu schaffen. Damit steht der Weg offen, zukünftige Speicherlösungen effizienter zu gestalten und an die dynamischen Geschäftsziele anzupassen.

SDS-Technologien wie Datacore Sansymphony-V werden bereits seit 16 Jahren im Produktivbetrieb eingesetzt und sind auf der Basis dieser praktischen Erfahrung weiterentwickelt worden. Wer die Anschaffung neuer Hardware, den Einsatz von Flash-Speicher oder Server- und Desktop-Virtualisierungsprojekte plant, wird die evidenten Vorteile einer SDS-Plattform genauer prüfen. Vorreiter wie Datacore bieten hierfür Hilfen wie einen ROI-Kalkulator sowie kostenlose Software für Testzwecke.

Bahnhofstraße 18, D-85774 Unterföhring

Tel: +49 (0)89 - 46 13 57 00, Fax: +49 (0)89 - 461 35 70 90

E-Mail: infoGermany@datacore.com