Cloudian: KI-Workloads kehren ins Rechenzentrum zurück

Die Public-Cloud bleibt für KI wichtig, verliert laut einer von Cloudian beauftragten Studie aber den Alleinanspruch. Viele Unternehmen verlagern sensible oder latenzkritische KI-Workloads zurück ins eigene Rechenzentrum oder bauen Hybrid-Modelle aus. Als Hauptgründe gelten Datenhoheit, besser kalkulierbare Kosten und Anforderungen an die Echtzeit-Performance.

Die Public-Cloud bleibt für KI wichtig, verliert laut einer von Cloudian beauftragten Studie aber den Alleinanspruch. Viele Unternehmen verlagern sensible oder latenzkritische KI-Workloads zurück ins eigene Rechenzentrum oder bauen Hybrid-Modelle aus. Als Hauptgründe gelten Datenhoheit, besser kalkulierbare Kosten und Anforderungen an die Echtzeit-Performance.

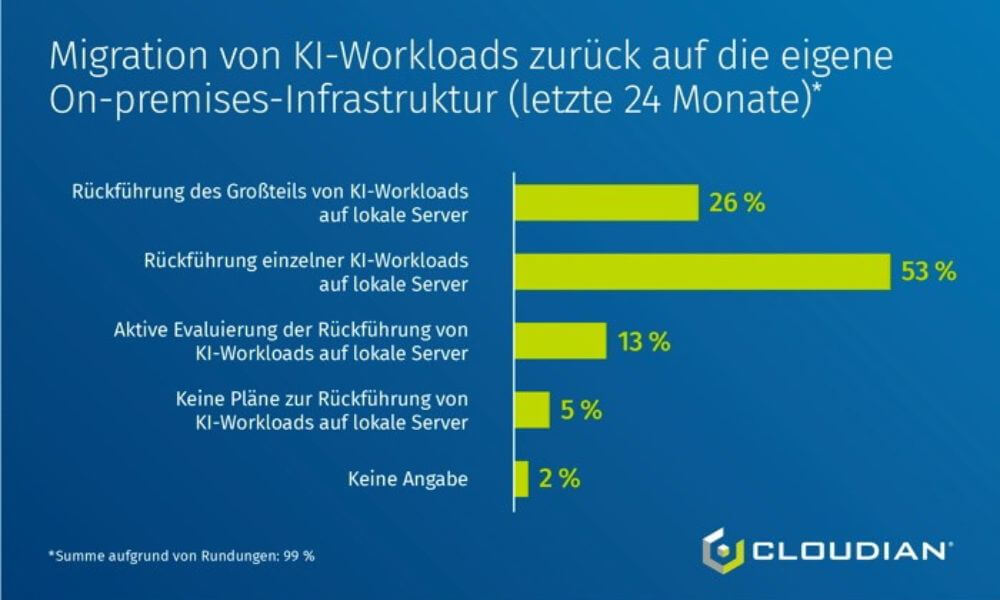

Mit dem KI-Boom wächst in Unternehmen offenbar auch die Bereitschaft, Workloads wieder näher an die eigenen Daten und Systeme zu holen. Nach Angaben von Cloudian haben 79 Prozent der befragten Unternehmen in den vergangenen 24 Monaten bereits KI-Workloads aus der Public-Cloud auf lokale oder private Infrastrukturen zurückverlagert oder befinden sich in diesem Prozess. Weitere 13 Prozent prüfen eine solche Repatriierung derzeit aktiv. Für die kommenden 24 Monate planen 73 Prozent, ihre On-Premises-Kapazitäten auszubauen oder Hybrid-Modelle mit stärkerem lokalen Anteil zu erweitern.

Bemerkenswert ist dabei, dass diese Entscheidungen nicht mehr nur aus einer Experimentierphase heraus getroffen werden. Laut Studie haben 63 Prozent der befragten Unternehmen KI bereits über Pilotprojekte hinaus skaliert, in Produktiv-Anwendungen überführt oder in Kernprozesse integriert. Das verleiht den Infrastruktur-Entscheidungen deutlich mehr operatives Gewicht.

Datenhoheit bleibt der stärkste Treiber

Der wichtigste Grund für lokale KI-Infrastrukturen ist laut der Erhebung die Kontrolle über sensible Daten. Wenn es um neue KI-Anwendungen mit vertraulichen Unternehmensdaten geht, würden 91 Prozent der Befragten On-Premises-, Private-Cloud- oder Hybrid-Modelle einer klassischen Public-Cloud-Nutzung vorziehen. Gleichzeitig berichten 58 Prozent, dass Bedenken rund um Datenstandort und Datenhoheit KI-Projekte bereits verzögert, eingeschränkt oder ganz ausgebremst haben.

Hinzu kommt das Thema Shadow-AI: 74 Prozent stufen die unkontrollierte Nutzung von Cloud-basierten KI-Werkzeugen durch Mitarbeitende als erhebliches oder kritisches Sicherheitsrisiko ein. Zudem berichten 24 Prozent von dokumentierten Fällen, in denen vertrauliche Daten in Cloud-KI-Dienste hochgeladen wurden. 50 Prozent der Unternehmen haben bereits spezielle Kontrollen eingeführt, um sensible Daten von solchen Diensten fernzuhalten.

93 % der Unternehmen verlagern KI-Workloads bereits aus der Public-Cloud zurück oder planen diesen Schritt. Laut Cloudian die wichtigsten Gründe: Kostenkontrolle, Performance und Datensouveränität. (Grafik: Cloudian)

93 % der Unternehmen verlagern KI-Workloads bereits aus der Public-Cloud zurück oder planen diesen Schritt. Laut Cloudian die wichtigsten Gründe: Kostenkontrolle, Performance und Datensouveränität. (Grafik: Cloudian)

Nicht nur Cloud-Kosten, auch Integration kostet

Auch bei den Kosten ergibt sich ein differenzierteres Bild, als es die reine Diskussion über Cloud-Rechnungen vermuten lässt. Zwar geben 40 Prozent an, dass ihre tatsächlichen Ausgaben für Cloud-basierte KI-Workloads über den ursprünglichen Planungen lagen. Als häufigstes Kostenhemmnis für eine breitere KI-Einführung nennen die Befragten jedoch Datenaufbereitung und Integration mit 45 Prozent. Dahinter folgen die Kosten für spezialisiertes KI-Fachpersonal mit 34 Prozent sowie Software-Lizenzen mit 31 Prozent.

Damit verschiebt sich die Debatte ein Stück weit. Es geht nicht nur um die Frage, ob die Public-Cloud zu teuer oder zu volatil bepreist ist. Es geht auch darum, wie aufwendig es ist, Datenbestände, Prozesse und Werkzeuge überhaupt in einen produktiven KI-Betrieb zu überführen. Gerade für Unternehmen mit gewachsenen IT-Landschaften dürfte das ein nicht zu unterschätzender Punkt sein.

Echtzeit-Performance spricht für lokale Systeme

Ein weiterer Treiber ist die Latenz. Drei Viertel der befragten Unternehmen geben an, bereits heute oder in absehbarer Zeit KI-Workloads zu betreiben, die von einer lokalen Verarbeitung profitieren oder diese sogar voraussetzen. Genannt werden unter anderem Echtzeit-Videoanalyse, Qualitätskontrolle in der Fertigung und transaktionsnahe Verarbeitung mit niedrigen Antwortzeiten. Für 37 Prozent sind solche Workloads bereits produktiv im Einsatz, weitere 37 Prozent planen entsprechende Szenarien.

Gerade dort, wo Datenströme ohne Umweg über entfernte Cloud-Ressourcen verarbeitet werden sollen, bleibt On-Premises damit technisch attraktiv. Das ist vor allem ein pragmatischer Infrastruktur-Entscheid.

Hybrid-Modelle dürften zum Standard werden

Von einem generellen Abschied von der Cloud kann dennoch keine Rede sein: 51 Prozent wollen vor allem Hybrid-Modelle mit zusätzlichen lokalen Kapazitäten ausbauen. Nur 22 Prozent planen eine stärkere Verlagerung direkt in On-Premises- oder private Infrastrukturen. Dagegen wollen lediglich 10 Prozent ihre Public-Cloud-Nutzung weiter erhöhen.

Dazu passt auch die Einordnung von Jon Toor, CMO bei Cloudian: »Unternehmen kehren der Public-Cloud natürlich nicht den Rücken. Sie machen sich nur mehr Gedanken, wo welche KI-Workloads am besten angesiedelt sind. Der Enterprise AI Infrastructure Survey 2026 bestätigt, was wir täglich von unseren Kunden hören: Wenn sensible Daten, planbare Kosten und Echtzeitleistung entscheidend sind, bietet eine lokale KI-Infrastruktur Vorteile, die die Public-Cloud nicht erreichen kann.«